Anthropic en Project Glasswing: AI en cybersecurity botsen

Anthropic schakelt ook concurrenten in om AI-cyberrisico’s te beteugelen

De AI-markt spreekt graag over snelheid, automatisering en schaal. Toch laat de recente stap van Anthropic zien dat er een andere realiteit onder die ontwikkeling ligt. Het bedrijf presenteerde begin april 2026 Project Glasswing, een samenwerkingsverband rond Claude Mythos Preview, een nieuw model dat volgens Anthropic sterk is in coding en agentic taken en daardoor ook uitzonderlijk relevant is voor cybersecurity.

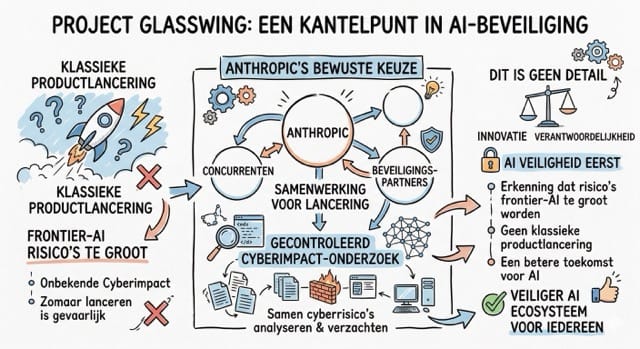

Anthropic stelt dat Mythos Preview in staat is kwetsbaarheden te vinden, complexe software beter te analyseren en defenders te helpen bij het opsporen van zwakke plekken in kritieke systemen. Het model wordt daarom niet breed vrijgegeven. In plaats daarvan krijgen geselecteerde partijen eerst toegang, waaronder grote namen uit technologie, cybersecurity en infrastructuur. Volgens Reuters gaat het onder meer om Amazon, Microsoft, Apple, Google, Nvidia, CrowdStrike en Palo Alto Networks.

Die keuze is veelzeggend. Ze laat zien dat frontier-AI niet langer alleen draait om tekst, productiviteit of klantcontact. De technologie raakt nu ook direct aan digitale veiligheid. En zodra dat gebeurt, verschuift de discussie automatisch van innovatie naar beheersing.

Waarom Project Glasswing zo belangrijk is

Project Glasswing is geen gewone productintroductie. Het is eerder een gecontroleerde verdedigingsfase. Anthropic wil partners tijd geven om hun eigen systemen te testen, kwetsbaarheden te verkleinen en bredere gevolgen van zulke AI-capaciteiten te begrijpen voordat die technologie verder wordt verspreid. WIRED beschrijft dit als een poging om de sector voor te bereiden op een wereld waarin AI-capaciteiten rondom cyber snel breder beschikbaar kunnen worden.

Dat is logisch. Een model dat defenders helpt bij het vinden van kwetsbaarheden, kan in verkeerde handen ook een versneller voor aanvallers worden. Reuters meldde dat Anthropic juist daarom spreekt over een cybersecurity-initiatief, niet over een gewone commerciële uitrol. Volgens de berichtgeving heeft het model al duizenden belangrijke softwarekwetsbaarheden helpen identificeren.

De kern is dus dubbel. AI kan helpen beveiligen. Maar dezelfde AI kan ook de drempel verlagen voor misbruik. Precies daar zit de urgentie.

De bredere les voor organisaties

Veel organisaties zullen denken dat dit vooral relevant is voor Big Tech. Dat is te kort door de bocht. De werkelijke les is dat AI-capaciteiten sneller groeien dan het beleid, de governance en de veiligheidsstructuren van veel organisaties.

Zodra modellen beter worden in code-analyse, kwetsbaarhedendetectie en securitytesting, is AI niet meer alleen een onderwerp voor innovatie of IT. Dan raken ook directie, compliance, legal, HR en risk betrokken. De relevante vraag wordt dan niet alleen welke tools medewerkers gebruiken, maar ook wie verantwoordelijk is voor toezicht, risicobeheersing en duidelijke kaders.

Dat sluit nauw aan op de visie van AI Personeelstraining: AI-adoptie is alleen duurzaam als governance, training, veiligheid, transparantie en continue monitoring met elkaar verbonden zijn. In de schrijf- en positioneringsrichtlijnen van AI Personeelstraining ligt de nadruk precies op dat zakelijke en verantwoordelijke gebruik van AI binnen organisaties.

In de AI Personeelstraining Methode onderscheiden we drie lagen die hier gelijktijdig verschuiven: wie AI gebruikt, wie toezicht houdt, en wie eindverantwoordelijk is als het misgaat.

AI wordt hiermee wezenlijk anders

Project Glasswing laat zien dat de sector opschuift van experiment naar volwassenheid. Niet alleen: wat kan dit model? Maar vooral: wat betekent dit voor onze digitale weerbaarheid? Voor bestuurders is dat een wezenlijk verschil. Het gaat dan ineens over eigenaarschap, escalatie, interne afspraken en AI-geletterdheid. Welke processen mogen met AI worden ondersteund? Welke risico’s accepteert de organisatie wel of niet? Hoe wordt gebruik gecontroleerd? En hoe snel kan men handelen als AI nieuwe zwakke plekken zichtbaar maakt?

Dat soort vragen vraagt om meer dan een losse handleiding. Het vraagt om training, duidelijke verantwoordelijkheden en een praktisch beleidskader. Precies dat type aanpak komt terug in het bredere profiel van AI Personeelstraining, waarin organisaties worden geholpen om AI niet alleen slim, maar ook verantwoord en werkbaar toe te passen.

In de praktijk zien wij dat AI-beleid nog te vaak geregeld wordt bij IT — terwijl eigenaarschap, escalatie en beslissingsbevoegdheid bestuursvraagstukken zijn.

Waarom dit ook in Europa zwaar telt

Voor Europese organisaties is deze ontwikkeling extra relevant. Naarmate AI verder ingrijpt op veiligheid, processen en besluitvorming, wordt verantwoord gebruik geen vrijblijvende wens meer maar een managementverantwoordelijkheid. Dat betekent dat organisaties een gezamenlijke taal moeten ontwikkelen rond AI-risico’s, interne controle en praktisch gebruik.

Dat begint meestal niet met techniek, maar met bewustwording. Medewerkers moeten begrijpen wat AI kan, waar de grenzen liggen en welke risico’s ontstaan als krachtige modellen zonder duidelijke afspraken worden ingezet. Daarna volgt pas de volgende stap: beleid, governance en structurele implementatie.

Daarmee is de stap van Anthropic dus groter dan alleen een technisch nieuwtje. Het is een signaal dat de markt erkent dat krachtige AI-systemen ook nieuwe veiligheidsverhoudingen creëren.

Cybersecurity-gerelateerde AI-toepassingen vallen onder de high-risk categorieën van de EU AI Act — wat betekent dat organisaties die dit nu negeren, straks twee problemen tegelijk hebben: een beveiligingsgat en een compliance-probleem.

Conclusie

Project Glasswing markeert een kantelpunt. Anthropic kiest er bewust voor om concurrenten en beveiligingspartners naast zich te zetten om de cyberimpact van een krachtig model eerst gecontroleerd te onderzoeken. Dat is geen detail. Het is een erkenning dat de risico’s van frontier-AI te groot worden voor een klassieke productlancering.

Voor organisaties is de boodschap helder. AI-adoptie zonder governance is geen strategie. AI-adoptie zonder training is geen transformatie. En AI-adoptie zonder veiligheidskader vergroot in veel gevallen vooral de blootstelling.

Wie AI serieus wil inzetten, moet dus niet alleen investeren in tools, maar ook in beleid, bewustwording, AI-geletterdheid en bestuurlijke controle.

Veelgestelde vragen over Anthropic, Project Glasswing en AI-cyberrisico’s

Wat is Project Glasswing van Anthropic?

Project Glasswing is een samenwerkingsinitiatief van Anthropic waarbij grote technologie-, cybersecurity- en infrastructuurpartijen vroege toegang krijgen tot Claude Mythos Preview. Het doel is om kwetsbaarheden en cyberrisico’s sneller te identificeren en kritieke software beter te beschermen voordat zulke AI-capaciteiten breder beschikbaar worden.

Wat is Claude Mythos Preview?

Claude Mythos Preview is een nieuw AI-model van Anthropic dat sterk is in coding en agentic taken. Juist doordat het model software diepgaand kan analyseren, is het ook zeer relevant voor cybersecurity, bijvoorbeeld bij het opsporen van kwetsbaarheden, misconfiguraties en mogelijke aanvalsketens.

Waarom werkt Anthropic samen met concurrenten zoals Microsoft, Google en Apple?

Anthropic kiest voor samenwerking omdat de cyberimpact van krachtige AI-modellen groter wordt dan één bedrijf alleen kan beheren. Door concurrenten en beveiligingspartners vroeg te laten testen, ontstaat meer tijd om kwetsbaarheden te beperken en verdedigingsmaatregelen op te bouwen voordat zulke mogelijkheden breder beschikbaar komen.

Waarom is dit relevant voor gewone organisaties en niet alleen voor Big Tech?

Dit nieuws laat zien dat AI niet alleen een productiviteitstool is, maar ook een security- en governancevraagstuk. Zodra AI-systemen beter worden in code-analyse en securitytesting, raken ook compliance, risk, HR, legal en bestuur betrokken. Organisaties moeten daarom niet alleen nadenken over gebruik, maar ook over eigenaarschap, beleid, training en toezicht.

Wat betekent deze ontwikkeling voor AI-beleid binnen organisaties?

Deze ontwikkeling maakt duidelijk dat AI-beleid breder moet zijn dan alleen afspraken over slim gebruik. Organisaties moeten ook vastleggen welke AI-toepassingen zijn toegestaan, wie verantwoordelijk is voor toezicht, hoe risico’s worden beoordeeld en hoe medewerkers veilig met AI omgaan. Zonder zulke kaders groeit de blootstelling aan fouten, datalekken en cyberrisico’s.

Wat kunnen organisaties nu al doen om zich voor te bereiden?

De eerste stap is AI-geletterdheid: medewerkers en management moeten begrijpen wat AI kan, waar de grenzen liggen en welke risico’s ontstaan. Daarna volgen duidelijke interne afspraken, governance, beleid en monitoring. Wie nu begint met verantwoord AI-gebruik, staat sterker wanneer krachtigere modellen breder beschikbaar komen.

Wat kunnen organisaties nu al doen?

Begin met AI-geletterdheid, duidelijke interne afspraken, eigenaarschap en beleid. Breng in kaart waar AI al wordt gebruikt, welke risico’s daarbij horen en wie verantwoordelijk is voor toezicht en besluitvorming. Dat is de basis voor verantwoorde implementatie.

Vrijblijvend meer info over AI training

Bronnen

WIRED – Anthropic Teams Up With Its Rivals to Keep AI From Hacking Everything

Reuters – Anthropic touts AI cybersecurity project with Big Tech partners